Od cloudu k lokálnímu provozu

Ještě před pár lety se o umělé inteligenci mluvilo téměř výhradně v kontextu cloudových služeb. Princip byl jednoduchý: pošlete data na vzdálený server, model je zpracuje a vrátí vám výsledek. Jenže tento přístup začíná narážet na své limity. A nejde jen o technologii – stále větší roli hrají otázky bezpečnosti, legislativy a provozní nezávislosti.

Proto se čím dál víc firem i vývojářů obrací k lokální AI. Tedy k řešením, kde model běží přímo na vašem zařízení nebo v rámci firemní infrastruktury. Data nikam neodcházejí, neprocházejí přes servery třetích stran a vy máte nad celým procesem plnou kontrolu. Zní to ideálně, jenže tady příběh teprve začíná.

Lokální LLM jako mozek aplikace

Lokální velké jazykové modely (LLM) se dnes prosazují jako nová aplikační vrstva. A tady je důležité zbořit jednu rozšířenou představu: lokální AI není jen chatbot, který funguje offline. Moderní lokální modely slouží jako rozhodovací jádro celé aplikace. Analyzují texty, třídí dokumenty, vyhodnocují vstupy od uživatelů a navrhují další kroky. Jinými slovy – z AI se stává backend nové generace.

Martin Krček z Počítačové školy GOPAS, který se tématu lokálních LLM věnuje dlouhodobě, to shrnuje poměrně trefně. Podle něj nejde o to, propagovat další technologický trend, ale nabídnout realistický pohled na to, kam lokální modely v architektuře aplikací skutečně patří. Jeho připravovaná prezentace na konferenci JSDays (14. dubna 2026) by měla ukázat, kde lokální AI dává smysl, jak ji začlenit do moderních JavaScript aplikací a jak k ní přistupovat bezpečně.

Jak to dělá Google a proč je to zajímavé

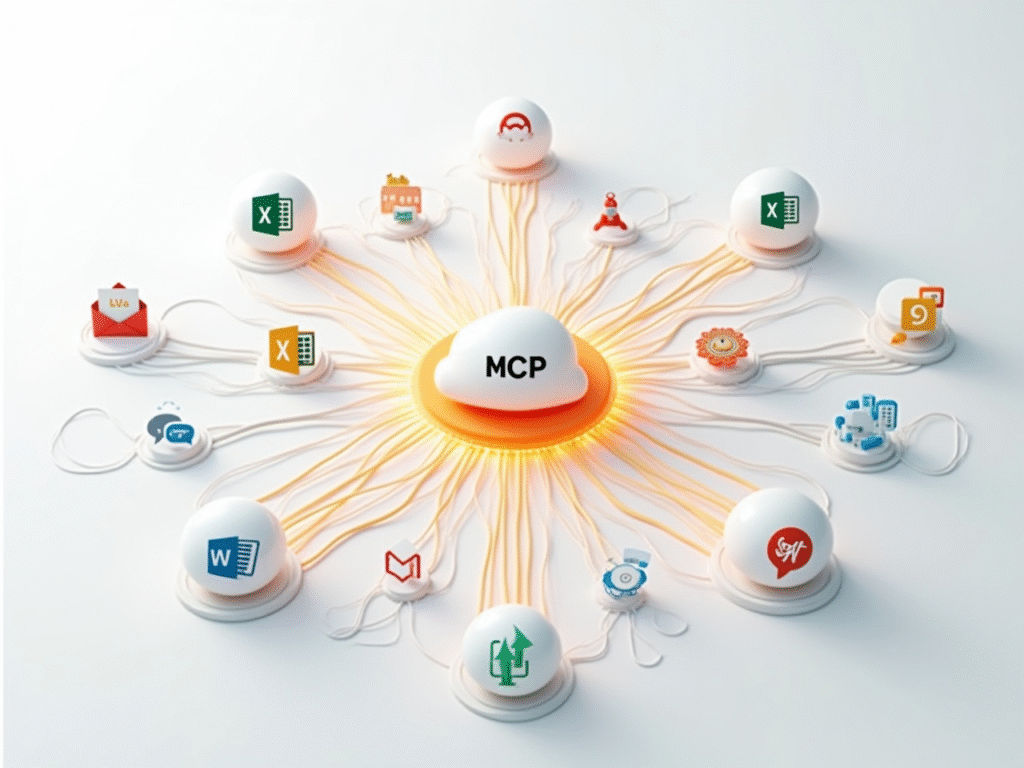

Dobrým příkladem promyšleného přístupu k lokální AI je Google. Místo jednoho univerzálního modelu, který má zvládat všechno, Google odděluje role. Pro vnímání světa – rozpoznávání obrazu, zvuku nebo gest – používá lehké lokální nástroje jako framework MediaPipe. Ten běží přímo na zařízení, je deterministický a pracuje s minimální latencí. Pro práci s textem, kontextem a rozhodováním pak slouží otevřený jazykový model Gemma, který může běžet lokálně a vývojář nad ním má plnou kontrolu.

Google navíc v poslední době posouvá hranice ještě dál. V prohlížeči Chrome začíná integrovat jazykové modely přímo jako součást platformy – takzvané Built-in AI. Vývojáři tak mohou pomocí JavaScriptu pracovat s lokálním modelem (konkrétně Gemini Nano) podobně jednoduše, jako dnes používají webové rozhraní pro geolokaci nebo práci s lokálním úložištěm.

Tím odpadá jedna z hlavních překážek lokální AI na webu. Uživatelé už nemusí stahovat obrovské datové balíky jen proto, aby si aplikace mohla trochu „popřemýšlet”. Lokální AI se tak poprvé začíná chovat jako běžná součást webového prostředí, nikoli jako experimentální doplněk pro nadšence.

Bezpečnost: lokální neznamená bezpečné

A tady přichází to nejdůležitější. Mnoho lidí (a bohužel i firem) se domnívá, že pokud model běží lokálně, automaticky to řeší veškeré bezpečnostní obavy. Data přece neopouštějí síť, tak v čem je problém?

Problémů je hned několik. Jazykový model – i ten lokální – může udělat chybný závěr. Může být ovlivněn nevhodným nebo záměrně manipulovaným vstupem. Může získat přístup k funkcím nebo datům, které mu vůbec nebyly určeny. A pokud nemáte jasně nastavené hranice toho, co model smí a nesmí, riskujete, že se z něj stane další netransparentní prvek ve vaší aplikaci.

V praxi to znamená, že lokální provoz je sice nutná, ale rozhodně ne dostatečná podmínka pro bezpečnou AI. K tomu potřebujete auditovatelnost – tedy schopnost zpětně zkontrolovat, co model dělal a proč. Potřebujete promyšlený návrh architektury, který jasně definuje, ke kterým datům a funkcím má model přístup. A potřebujete pravidla, která se nejen stanoví, ale také průběžně kontrolují a aktualizují.

Co si z toho odnést pro praxi

Pokud ve firmě uvažujete o nasazení lokální AI – nebo ji už používáte – stojí za to položit si několik zásadních otázek. Má model jasně vymezené hranice toho, co smí dělat? Existuje mechanismus, jak zpětně ověřit jeho rozhodnutí? Jsou ošetřeny situace, kdy model dostane neočekávaný nebo záměrně zavádějící vstup?

Lokální AI je skvělý nástroj. Snižuje závislost na cloudových službách, chrání data před přenosem mimo firmu a dává vám kontrolu nad tím, jaký model a v jaké verzi používáte. Jenže jako každý nástroj – i to nejlepší kladivo vám nepostaví dům, pokud nevíte, kam zatlouct hřebík.

Přístup „nasadíme to lokálně a máme vyřešeno” je nebezpečný právě proto, že vytváří falešný pocit bezpečí. A v oblasti AI, kde se rozhodnutí modelu promítají do reálných procesů a dat, si falešné jistoty nemůžeme dovolit.

Zdroj: SystemOnline