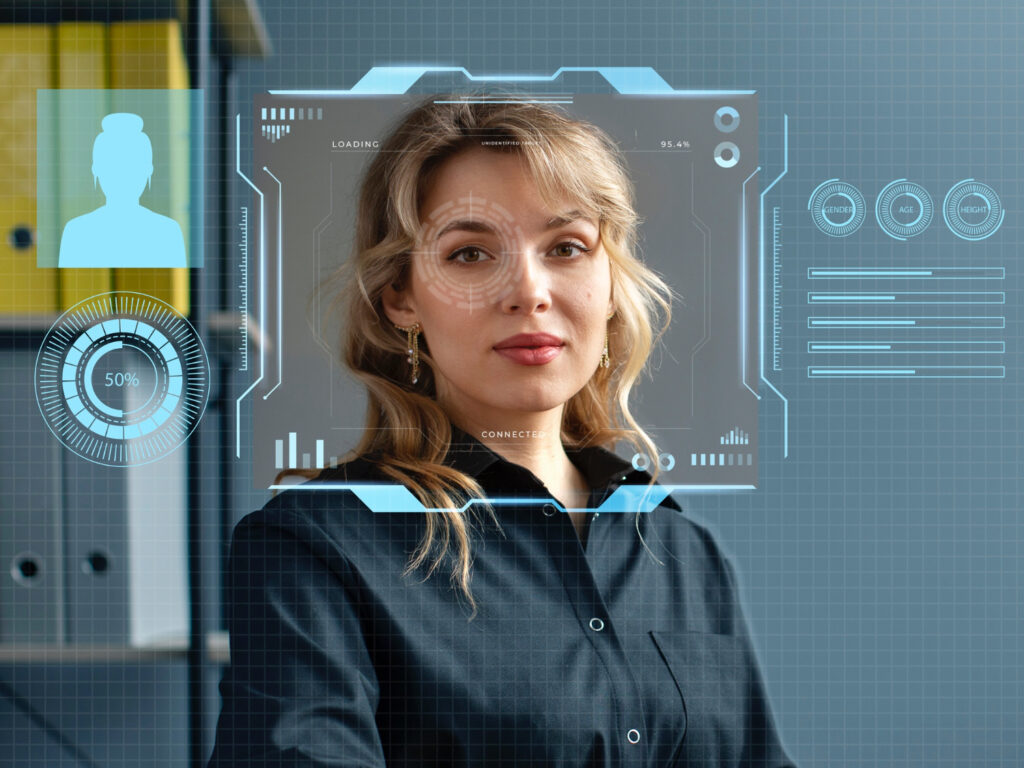

Umělá inteligence v náboru: rychlost, efektivita, ale i nová rizika

AI nástroje dnes zásadně mění způsob, jakým firmy hledají, hodnotí a přijímají nové zaměstnance. Podle Responsible AI Index využívalo v roce 2024 umělou inteligenci při náboru „mírně“ nebo „výrazně“ už 62 % australských organizací. Tyto systémy dokážou třídit, hodnotit a skórovat uchazeče, analyzovat jejich osobnost, chování nebo schopnosti a rozhodovat, kdo postoupí do dalšího kola výběrového řízení. AI tak šetří čas a umožňuje pracovat s obrovským množstvím dat, což by lidský personalista nezvládl. Jenže právě tato rychlost a rozsah přináší i nové a závažné hrozby diskriminace.

Jak diskriminace vzniká a koho se nejvíce týká

Riziko diskriminace je u AI systémů dvojí: může být zabudované přímo v datech nebo algoritmech, ale také souvisí se způsobem, jakým firmy AI používají. Výzkum ukazuje, že nejvíce jsou ohroženy ženy, starší uchazeči, lidé s hendikepem a ti, kdo mají cizí přízvuk. Například AI nemusí být přístupná nebo ověřená pro uchazeče se zdravotním postižením. Jeden z kariérních koučů popsal případ svého neurodivergentního klienta, který byl špičkovým studentem, ale kvůli nestandardním odpovědím v osobnostních testech nikdy neprošel do dalšího kola. AI mu jednoduše přiřadila nízké skóre, aniž by zohlednila jeho skutečné schopnosti.

Nedostatek transparentnosti a nové bariéry

Dalším problémem je netransparentnost AI procesů. Uchazeči často nevědí, že jsou hodnoceni AI, neznají kritéria ani časové limity pro odpovědi. To může vést k tomu, že jsou „odříznuti“ v půlce odpovědi, aniž by měli šanci se obhájit. Pro některé skupiny, například osoby s hendikepem, je pak téměř nemožné se v procesu zorientovat a hájit svá práva. Kromě toho vznikají nové bariéry: uchazeči musí mít telefon, stabilní internet a digitální gramotnost. Pro některé to může být důvod, proč se o práci vůbec nepokusí nebo z procesu odstoupí.

Právní ochrana a co je potřeba změnit

Současné australské antidiskriminační zákony se vztahují i na AI v náboru, ale mají mezery. Zákony by měly být upraveny tak, aby v případě soudního sporu nesl důkazní břemeno zaměstnavatel – tedy aby musel prokázat, že AI systém nediskriminoval. Dnes je naopak na uchazečích, aby diskriminaci prokázali, což je u složitých a netransparentních systémů téměř nemožné. Další potřebnou změnou je právo na vysvětlení, když je AI použita v náboru. Vláda by měla zavést povinné „zábrany“ pro vysoce rizikové AI aplikace a zajistit, aby tréninková data byla reprezentativní, systémy přístupné i pro osoby s hendikepem a pravidelně nezávisle auditované.

Měly by být AI nástroje v náboru zakázány?

Některé skupiny volají po úplném zákazu AI v náboru, alespoň dokud nebudou existovat dostatečné záruky. Australský parlament například doporučil zakázat AI v HR, pokud rozhoduje bez lidského dohledu. Tyto návrhy mají své opodstatnění – riziko, že se diskriminace „zakóduje“ do systému a některé skupiny se k práci vůbec nedostanou, je reálné. Svět je sám o sobě zaujatý, ale pokud tuto zaujatost převedeme do algoritmů, hrozí, že diskriminace bude ještě méně viditelná a o to nebezpečnější.

Zdroje: Phys.org